我来提供一个特斯拉辅助驾驶系统的「瓜」吧。

这个「瓜」要从特斯拉大量使用 5 年以前的传感器说起。

特斯拉 Model Y 和其他 Model 系列的车型都采用了特斯拉的第三代硬件方案,称为 HW 3.0,也就是 HardWare 3.0 的缩写。

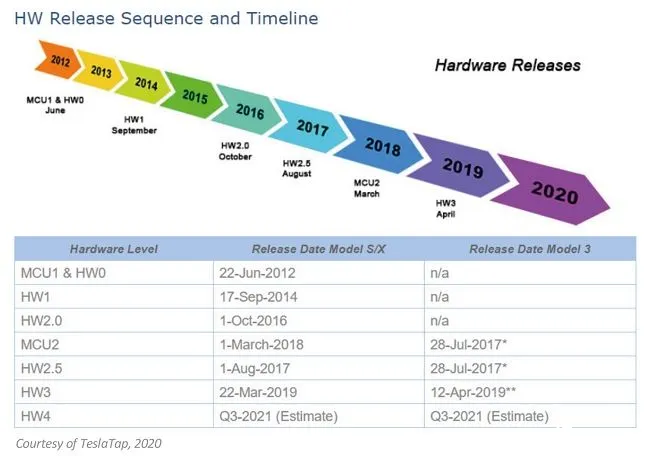

特斯拉每一代硬件更新的重点都是在主控芯片上。HardWare 1.0 采用的是全球最领先的视觉解决方案供应商 Mobileye 的感知芯片,得益于 Mobileye 强大的视觉感知能力,特斯拉推出了 AutoPilot 1.0,将自动辅助驾驶带入公众的视野,好景不长,16 年的一场严重交通事故的黑锅,特斯拉果断甩给了 Mobileye,然而 Mobileye 硬刚到底,不愿意接锅,直接终止了与特斯拉的合作。这件事使得特斯拉意识到了自研算法的重要性,于是在 2016 年 10 月投入英伟达的怀抱,使用 Nvidia PX2,并将感知摄像头从 1 个扩充到了 8 个,这就是 HardWare 2.0。再后来,特斯拉发现英伟达的芯片不仅价格贵,算力也逐渐吃不消,便开始了自研芯片,于 2019 年 3 月推出了自己的自动驾驶芯片 FSD,这就是 HardWare 3.0。

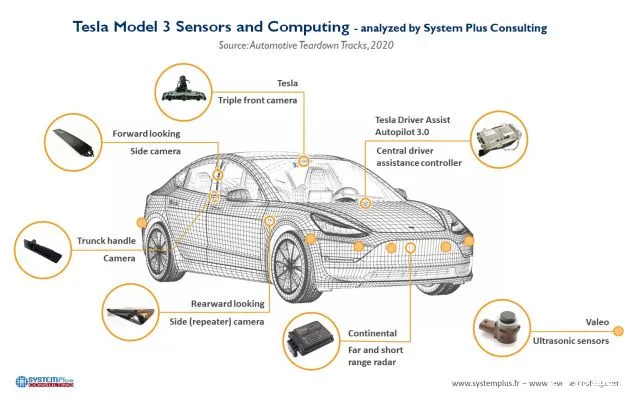

特斯拉 Hardware 3.0 除了使用全新的 FSD 控制芯片外,还包含了围绕在车身周围的 8 个摄像头(视频给特写,挡风玻璃下面有并排的 3 个摄像头,车身侧面前轮附近朝后的摄像头左右共 2 个,左右两侧 B 柱中共 2 个朝前的摄像头,车尾 LOGO 下方 1 个朝后的摄像头),1 个安装在前保险杠里面的毫米波雷达(此处可以做一个视频透过保险杠进入到 Radar 的特写),8 个安装在车身周围的超声波雷达,也就是我们常说的泊车雷达。

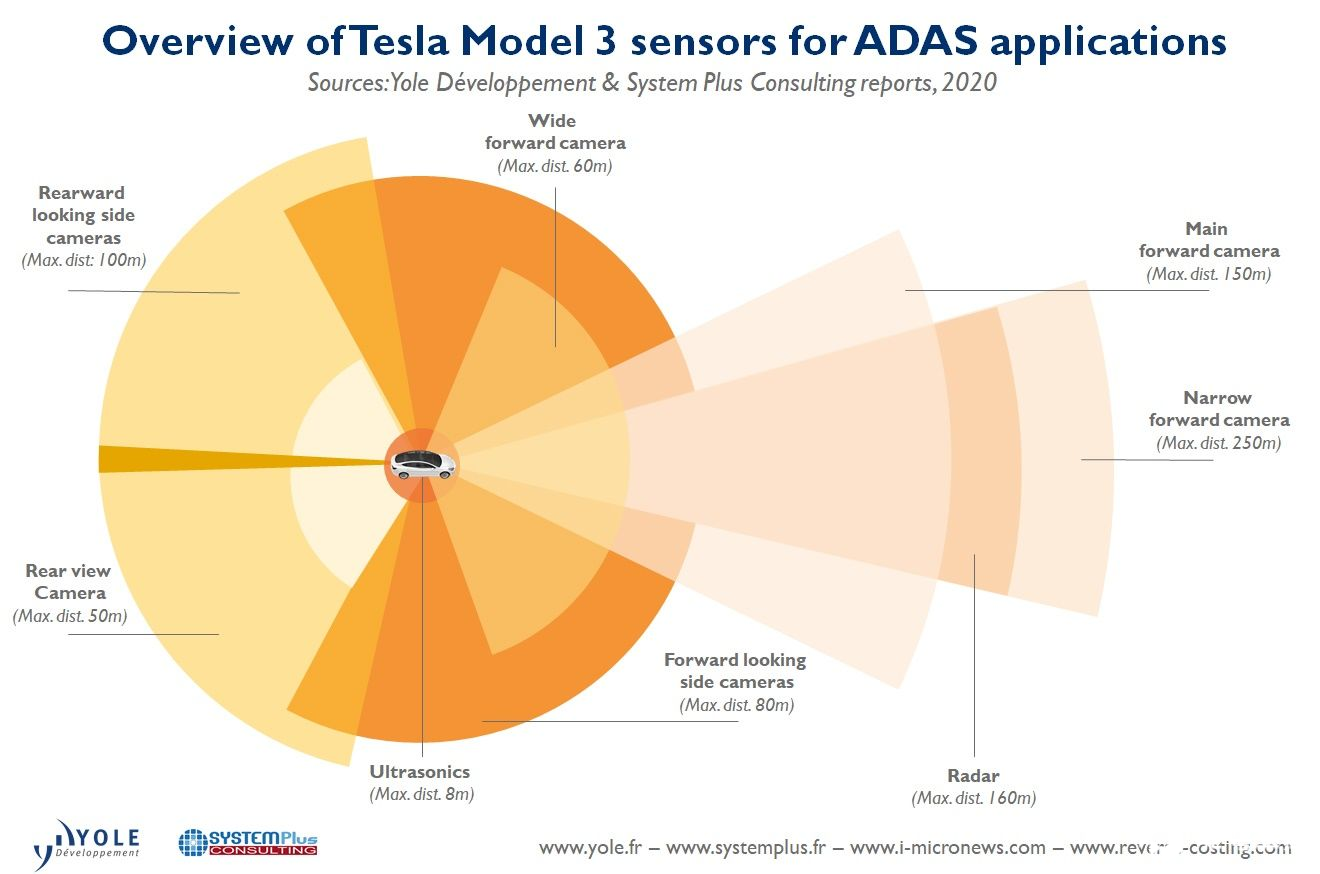

特斯拉的 8 个摄像头都来自同一家供应商 —— 美国的安森美(ON Semiconductor)半导体。这款摄像头发布于 2015 年,拥有 120 万的成像像素。在挡风玻璃下方有 3 个不同焦距的摄像头,长焦距的摄像头负责最远 250 米范围内的目标检测,中焦距负责最远 150 米范围内的目标检测,短焦距虽然看不远但看得广,因此比较多地用于近处目标或红绿灯的检测(如下图,可以做出动画来配合讲解,每讲一个范围,就出来一个扇形)。安装在左右两侧前轮的(需要前期拍点摄像头的特写)2 个侧后向摄像头负责感知侧后向来车的识别,安装在 B 柱里的 2 个前侧向摄像头负责感知前侧向的目标识别。正后向的 1 个摄像头负责感知后方更远的目标的检测。

特斯拉的前向毫米波雷达使用的是大陆的第四代雷达 ARS4-B,这款雷达的正式发售时间是 2016 年,距今已有超过 4 年时间。毫米波雷达可以弥补摄像头不能精确测距离和测速度的不足,业内常将毫米波雷达和摄像头进行信息融合,以实现对目标的精确感知。但大陆第四代雷达因为本身设计上的问题,不能实现目标高度的测量,在经过前方立交桥时会检出静止目标,很难从数据上区分检出的这个目标是桥还是桥下确实停着一辆车,此外毫米波雷达在隧道、地库的场景中会出现严重的多径效应,出现很多静止目标的误检。因此业内很多厂商做信息融合时,会将静止目标直接全部过滤掉,只使用运动的目标。特斯拉目前就是这么干的,于是就出现了 2020 年 6 月台湾嘉义的特斯拉撞上静止白色大货车的悲剧。

作为特斯拉的掌门人 —— 埃隆・马斯克习惯使用 「第一性原理」 来思考问题。在他眼里,既然人类能够只用双眼识别车道线、红绿灯、标识牌来完成感知交通环境,那么特斯拉一定也可以只靠车上的 8 个摄像头完成自动驾驶的环境感知任务,甚至还抛出 「用激光雷达的都是傻瓜」 的惊人言论,直接让全球的自动驾驶从业人员满脸黑线。

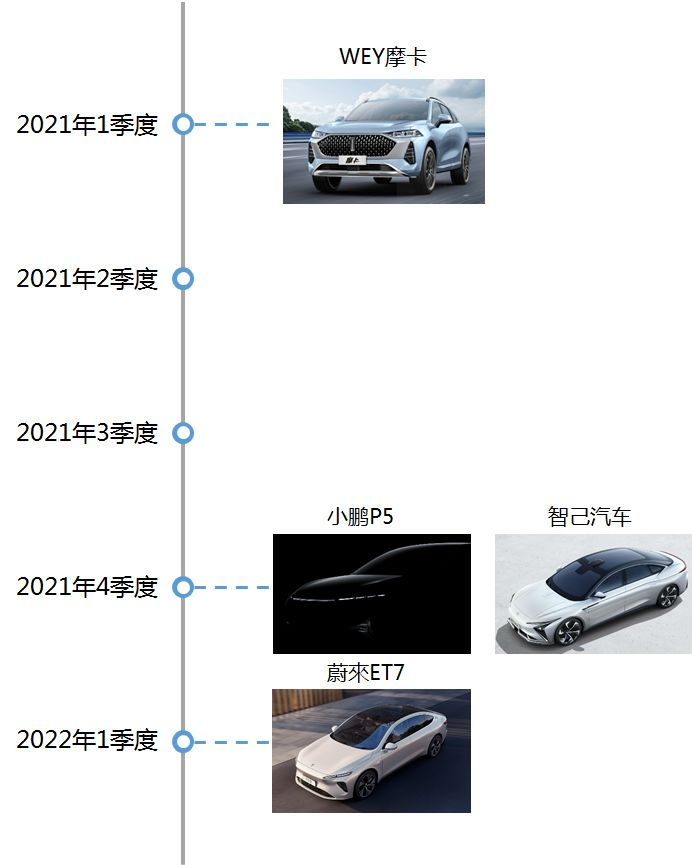

实际上国内的势力造车小鹏、蔚来、长城、智己都已经将全新的传感器方案排上日程。这些全新的方案都会将激光雷达作为主传感器来实现自动驾驶。

特斯拉 Model Y 现有的这套纯视觉、无冗余的技术方案是很难在国内城区做到全自动驾驶的,城区道路中存在大量的遮挡场景,冷不丁就横穿出某个异形障碍物,一旦训练视觉算法的数据集中不包含这类障碍物,那就很难保证驾驶的安全。因此多冗余的传感器方案是处理极端复杂场景的必由之路,而且国内的厂商已经把激光雷达的价格降到可接受范围了,马斯克,要不咱们就装一个吧。